搜索

关闭

智能的定义

发布时间:2021-07-21

近年来,人工智能的发展受到越来越多的关注。在大量围绕“智能”的讨论中,大家是否有这样的疑问:智能究竟是什么?

这个问题有何意义?除了对通用人工智能制造及哲学探索的需求之外,物理学中一些问题亦与之有关,譬如John Bell的著名提问:“在单细胞生物出现之前,波函数是否沉寂了数千亿年才等到了最终的跳跃?或者它是否必须等待一些具有博士学位的高素质测量员?(Was the wave function waiting to jump for thousands of millions of years until a single-celled living creature appeared? Or did it have to wait a little longer for some highly qualified measurer—with a Phd?)” [1]

于是,我们在构建智能的同时,亦寻求其定义。同时,力求该定义的“通用性”,希望它能满足上述种种需求,串联各个学科。

图1. 生物智能与计算机智能正在这个时代发生交互

(图片来自http://www.chinaguohong.com.cn/list/7/318.htm)

1.什么是定义?

在回答“如何定义智能”之前,还有个更根本的问题——“什么是定义”?Ned Block指出,存在两种定义:一种是对词汇的定义,另一种是对事物的定义[2]。拿一杯水举例,对词汇的定义是“这是一种透明的、广泛存在于江河湖海中的液体”,这样的定义指代的对象使得一个具备抽象语言能力的人类可以快速理解,对水这个事物的定义则是H2O。我们在定义智能的时候,也需要小心区分二者。我们真正需要的是对智能的事物的定义,即像定义“水是H2O”那样来定义智能。

图2. Ned Block

引言

关于“弱人工智能”与“强人工智能”的争论屡见不鲜,合适的定义应当能兼纳两者。容易的做法是用“类人智能”这个词回避此问题,譬如可以说:一个强大到足以解决N=NP问题的自动推理机不如一个6岁尚不懂乘法的孩童更具有智能,因为他不如那个孩童更像人。然而,人真的就是智能的代表吗?我们关于智能的叙述是否能被形式化?如果答案是肯定的,那么智能是否一定能形式化它自身?那么是否可以将“形式化自身”设为判定智能的必要条件?

大部分关于智能的定义,究其来路总具有逻辑实证主义的风格,并与前述对比定义更为接近。2006年,Shane Legg 和 Marcus Hutter把智能的定义分成了由心理学者提出的和由人工智能学者提出的[3]:

他们搜集了35则来自心理学者的定义,比较典型的有:

(1)“智能不是单一的、单一的能力,而是多种功能的组合。该术语表示在特定文化中生存和进步所需的能力组合。”

—— A. 阿纳斯塔西

(2)“这种思维方式是我们思考、解决新问题、推理和了解世界的能力的基础。”

——M. 安德

(3)“在我们看来,智力中存在一种基本能力,其改变或缺乏对实际生活至关重要。这种能力是判断力,也称为判断力、实践意识、主动性,是使自己适应环境的能力。”

——A. 比奈

图3. 现代对话系统中,计算机学习人类的对话。

(图片来自https://www.sciencedirect.com/science/article/abs/pii/S0747563216300048)

无论是像“智能是由智能测试来度量的(Intelligence is what is measured by intelligence tests.)” [4]这般实证的, 还是 “智能就是最优地利用有限资源,包括时间,来达成目标的能力。(Intelligence is the ability to use optimally limited resources including time to achieve goals. )” [5]这样递归的,都具有逻辑实证主义的风格。考虑到现代自然科学与其的紧密关系,这也是易于理解的。本文主要介绍两个对于智能的数学定义-- AIXI与 UCAI,虽然前者颇具逻辑实证主义,它们都继承了希尔伯特式的雄心,后者则更有柏拉图主义的色彩。

3. AIXI [6]

图4 . AIXI(图片来自http://www.hutter1.net/ai/aixicat.jpg)

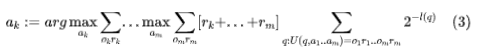

在人工智能领域中,强化学习是指在主体与环境的交互关系中,通过构建一个期望回报最大化的主体,来实现一种探索与利用的平衡。显而易见,这与上述R. Kurzweil [5] 的“智能就是最优地利用有限资源,包括时间,来达成目标的能力(Intelligence is the ability to use optimally limited resources including time to achieve goals.)。”是一脉相承的。其实在人工智能领域内这样的观点是比较主流的,类似的还有McCarthy [6]的 “智能是在世界中实现目标能力的计算部分。人类、许多动物和一些机器具有不同种类和程度的智能。(Intelligence is the computational part of the ability to achieve goals in the world. Varying kinds and degrees of intelligence occur in people, many animals and some machines)”。

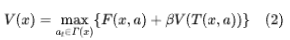

在控制论领域内,有着这样一个著名的贝尔曼方程。具体而言,根据最优化原理我们可以写出一个关于未来最优决策的表达式[7]:

引入了值函数以后,可以将(1)写成等价的递归表达式(2):

图 5. Marcus Hutter

AIXI是由Marcus Hutter提出的,通过将贝尔曼方程中的环境分布(未知的)转换成合适的一般化的Solomonoff分布,从而创建出的以最大化 为唯一目的的智能体。

作为一种强化学习,上式用马尔可夫链的形式简洁地描述了主体与环境的关系。其中,环境被一个确定程序的q给建模,主体需要做出离散化的第k步action,环境会提供 ok 作为观察值和rk 作为奖励。而未来的认知会有...ok rk ...om rm = U (q, a1..am) (其中U是执行q的单调图灵机)。而ak是AIXI这个主体基于过去的 o1 r1...ok-1 rk-1 之上的第k步的行动。这样的一个优化模型跟智能有什么关系呢?其实,通过对奖励的设置,智能体就会具有主动性,这与一般的深度强化学习模型是一致的。Hutter 将AIXI描述为在任意环境中具有最优表现意义上的最智能的无偏主体。那么AIXI与一般的强化学习模型有什么区别呢?区别在于环境的一般性。AI研究中的强化学习往往是针对稳定环境中单个复杂问题的,而生物的强化学习往往是在动态环境中的一些简单学习问题[9]。在这个意义上,AIXI通过对环境的一般化很好地反映了智能的特性。

图 6. 强化学习的基本步骤 (图片来自http://www.sra.vjti.info/blog/machine-learning/introduction-to-reinforcement-learning-in-2-minutes)

然而,不依赖于模型的强化学习在如今存在着比较多的问题,基于模型的强化学习最近也重新焕发生机[10]。后者与对于智能的定义相去甚远,而前者能否真正实现通用智能也尚不明确。此外,在物理世界中,决策是否是连续的,或者说是否可以被这样离散化呢?我想这应该是一个相当复杂的问题。此外,该理论仍有许多问题。

譬如,对于人类智能的解释方面尚不明确,尤其是建立宏观解释与行为学实验之间的鸿沟。我们能用这样的方式作为认知建模的通用模版吗?如果另一个智能体采用了与之相异的学习策略,我们是否能构筑一个良序的系统?甚至是一个拓扑空间或者赋距空间?Hutter对于这一理论的研究主要集中在2000-2006年这段时间中,并在他的专著 “Universal Artificial Intelligence”中集中地展示。此后的多年里他的研究兴趣有了转变。个人以为,目前想要把AIXI与人类的智能相联系也许可以有一些进化学上的解释,但是对具体的认知行为表现的解释还是比较困难的。

.png)

图 7 . 单细胞生物的群体智能[11](图片来自A. Tero et.al, (2010))

另外我认为,聚焦于人类智能时,主体是尚不明确的。作为AIXI的主体是不明的,其主体究竟是个体还是群组?毕竟,简单如单细胞生物尚能以群体的形态展现出智能[11]。

另外,很多人会惊讶于人类婴孩强大的小样本学习能力、推理能力与泛化能力,不过如果把他近似地看成一个神经网络的话,不仅网络的结构可能是由遗传搭好的,其参数的初始化等等也都是经过千百年的训练的,个体在何种程度上成为个体是可以被追问的。同样我们自然也会问,那么群体的智能是否同样遵循AIXI的描述呢?

还有一个问题是,如果智能真是如此定义,有没有对应的智能测试呢?Hutter的回答是有的,并且他声称构造出了一个通用的智能测试[6],然而果真如此吗? 至少Warren Smith并不同意。

4.UCAI

也是在本世纪初,Warren Smith开始了他对于智能的数学定义的尝试。与Hutter不同的是,他的路径有很强的理论计算机科学风格。他宣称Hutter所谓的通用智能测试是不存在的,我们应该用无穷多个智能测试来代替这样一个智能测试,而能够胜任这样的测试的便是UCAI。

Smith早年在MIT和普林斯顿学习数学,他对于UCAI的构建也充满了数学韵味,是通过对五则定理的证明来完成的[13]:

Theorem1

If P=NP thengodlike superintelligence is impossible, even if “God” knows the algorithminside SC.

Theorem 2

If P=NP thenapproximate godlike superintelligence is impossible, even if “God” is allowedto know the algorithm inside SC.

Theorem 3

Asymptoticallygodlike superintelligence is possible.

Theorem 4

An asymptotically godlikesuperintelligence is not possible if the polynomial timetest-problem-generation and-test-reent-algorithm instead has access to a truerandom bit generator.

五则定理的证明详见参考文献[13],我们来看最重要的定理5:

Theorem 5

A UACI is possible.

A “uniformly asymptotically competitive intelligence” (UACI) is arandomized reent-algorithm C which, when repeatedly given any intelligencetest, achieves an expected cumulative score at least asymptotically equal tothat achieved by any particular other randomized polytime reent-algorithm X on the same testsequence,while consuming compute time at most a constant factor larger than thoseconsumed by X, and memory resources growing at most linearly with time.

这里要解释一下的是reent算法,在计算机科学中这是指永不停机地,征求和接受来自一个或多个参与方的输入位串,并在两者之间输出位串的程序。通过这样的方式,Simth构造了一个能够解释人类智能的智能定义,并且在他的论文中专门讨论了IQ测试[13],这是AIXI所不及的。其实AIXI和UCAI的区别可以见下图:

图片图:Huttervs Smith [12]

5.讨论

关于智能定义的探讨最早可以追溯到1560年,如今已经成为一个高度交叉的领域。我认为,我们目前无法给出一个完美的定义,随着对于智能的认识逐渐深入,此前的定义也会被不断改进。最终这样的定义应是能符合物理学实验的(比如Bell的问题),能够与人类以及生物智能相容的(比如认知行为、意识等等),并且能够支撑起通用(一般)智能制造(或者我们终于证明了无法创造出通用智能)。

文:复旦大学数学学院 徐云龙

【参考文献】

[1] Bell, J. S. (2001). Quantum mechanics for cosmologists. John S Bell On The Foundations Of Quantum Mechanics, 99-125.

[2] Block, N. (1995). The mind as the software of the brain. New York, 3, 377-425.

[3] Legg, S., & Hutter, M. (2007). A collection of definitions of intelligence. Frontiers in Artificial Intelligence and applications, 157, 17.

[4] Boring, E. G. (1923). Intelligence as the tests test it. New Republic, 35(6), 35-37.

[5] Kurzweil, R. (2000). The age of spiritual machines: When computers exceed human intelligence. Penguin.

[6] Hutter, M. (2004). Universal artificial intelligence: Sequential decisions based on algorithmic probability. Springer Science & Business Media.

[7] McCarthy, John. (2004). What is Artificial Intelligence?www-formal.stanford.edu/jmc/whatisai/whatisai.html, 2004.

[8] Marcus Hutter. (2000) The AIXI Model in One Line http://www.hutter1.net/ai/uaibook.htm

[9] Neftci, E.O., Averbeck, B.B. (2019). Reinforcement learning in artificial and biological systems. Nat Mach Intell 1, 133–143. https://doi.org/10.1038/s42256-019-0025-4

[10] T. M. Moerland, J. Broekens, C. Jonker.Model-based Reinforcement Learning: A Survey

[11] A. Tero, S. Takagi, T. Saigusa, K. Ito, D. P. Bebber, M. D. Fricker, K. Yumiki, R. Kobayashi, T. Nakagaki. (2010). Rules for biologically inspired adaptive network design, Science 327 (5964), 439–442.

[12] Legg, Shane & Hutter, Marcus. (2005). A Universal Measure of Intelligence for Artificial Agents. IJCAI International Joint Conference on Artificial Intelligence. 19. 1509-1510.

[13] Smith, W.D. (2006). Mathematical definition of"intelligence"(and consequences).

loading......

loading......